OpenClaw配置Ollama教程:快速部署本地AI模型指南

在人工智能技术飞速发展的今天,能够在本地设备上运行大型语言模型已成为许多开发者和技术爱好者的迫切需求。OpenClaw作为一个功能强大的开源工具,与Ollama这一轻量级模型运行框架的结合,为用户提供了高效配置和部署本地AI模型的完美解决方案。本文将深入探讨如何配置OpenClaw与Ollama,帮助您快速搭建属于自己的智能应用环境。

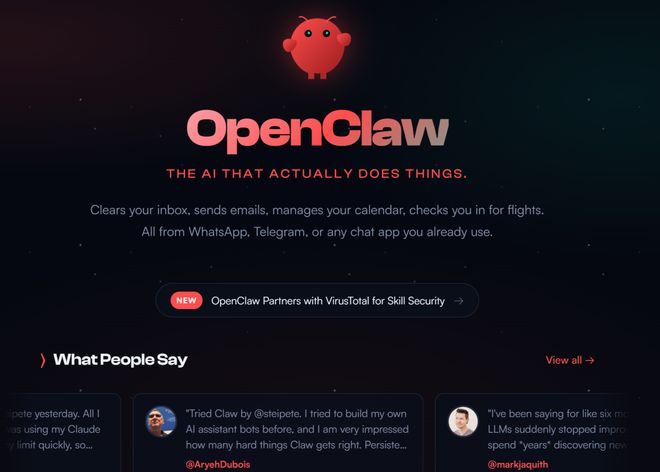

首先,了解OpenClaw和Ollama的基本概念至关重要。Ollama专为在本地运行大型语言模型而设计,它简化了模型的下载、管理和执行过程,支持包括Llama 2、CodeLlama、Mistral等在内的多种热门模型。而OpenClaw则提供了与这些模型交互的便捷接口和工具链,使得集成与应用开发变得更加顺畅。两者的结合,相当于为您的本地计算机装备了一个功能齐全的AI大脑。

配置过程的第一步是确保您的基础环境准备就绪。您需要在操作系统上安装Docker或直接安装Ollama的可执行文件。对于大多数用户,访问Ollama官网下载对应版本是最直接的途径。安装完成后,通过简单的命令行指令即可拉取所需的AI模型,例如执行“ollama run llama2”命令便会开始下载并运行Meta公司的Llama 2模型。

接下来是集成OpenClaw的关键步骤。您需要从开源仓库获取OpenClaw的源代码或安装包。根据其文档说明,通常需要配置环境变量,指向Ollama服务的地址(默认为本地localhost的11434端口)。OpenClaw的配置文件允许您指定默认使用的模型、生成参数如温度值和响应长度,从而定制化AI的交互行为。一个常见的配置场景是设置OpenClaw作为某个应用程序的后端服务,通过API调用本地Ollama模型来生成文本或代码。

在成功配置后,您可以体验本地AI模型的强大能力。由于所有计算均在本地进行,这带来了无与伦比的数据隐私性和响应速度。您可以用它进行文档摘要、代码编写辅助、创意写作或作为学习研究的工具。OpenClaw提供的友好界面或API,进一步扩展了其应用场景,使得从简单问答到复杂项目集成皆成为可能。

值得注意的是,配置过程中可能会遇到常见问题,例如端口冲突、模型加载内存不足或网络问题导致模型下载失败。建议用户确保系统有足够的存储空间和内存资源,并查阅Ollama和OpenClaw的官方故障排除指南。保持工具的版本更新也能获得更好的性能和新功能支持。

总之,通过OpenClaw配置Ollama,您不仅获得了一个高度可定制的本地AI平台,更是迈入了探索人工智能前沿的大门。这种配置方案特别适合注重数据安全、需要离线访问或希望深度控制模型行为的用户。随着开源模型的不断进化,这套工具组合将持续释放更大的潜力,成为您工作和创作中不可或缺的智能伙伴。